Umělá inteligence jako krize a příležitost: Klíčové myšlenky z přednášky Jana Romportla

15. února na Filozofické fakultě Masarykovy univerzity zazněla přednáška, která by měla změnit způsob, jakým přemýšlíme o budoucnosti práce, technologií i lidstva samotného.

Jan Romportl není typický AI evangelista. Je to vědec, nezávislý konzultant a expert, který se umělé inteligenci věnuje už od dob, kdy o ní téměř nikdo neslyšel. A právě proto jeho slova mají váhu. Ve své přednášce na brněnské filozofické fakultě nepřinesl jen technické detaily, ale varování i naději. A především jeden zásadní vzkaz: Šiřte světlo světa.

Kombinace akademické perspektivy, zkušeností z korporátního prostředí i startupového světa dává Romportlovu pohledu unikátní hloubku. A to, co řekl, by mělo zajímat každého, od studentů informatiky až po rodiče, kteří přemýšlejí o budoucnosti svých dětí.

Super-exponenciální růst: Konec programování, jak ho známe

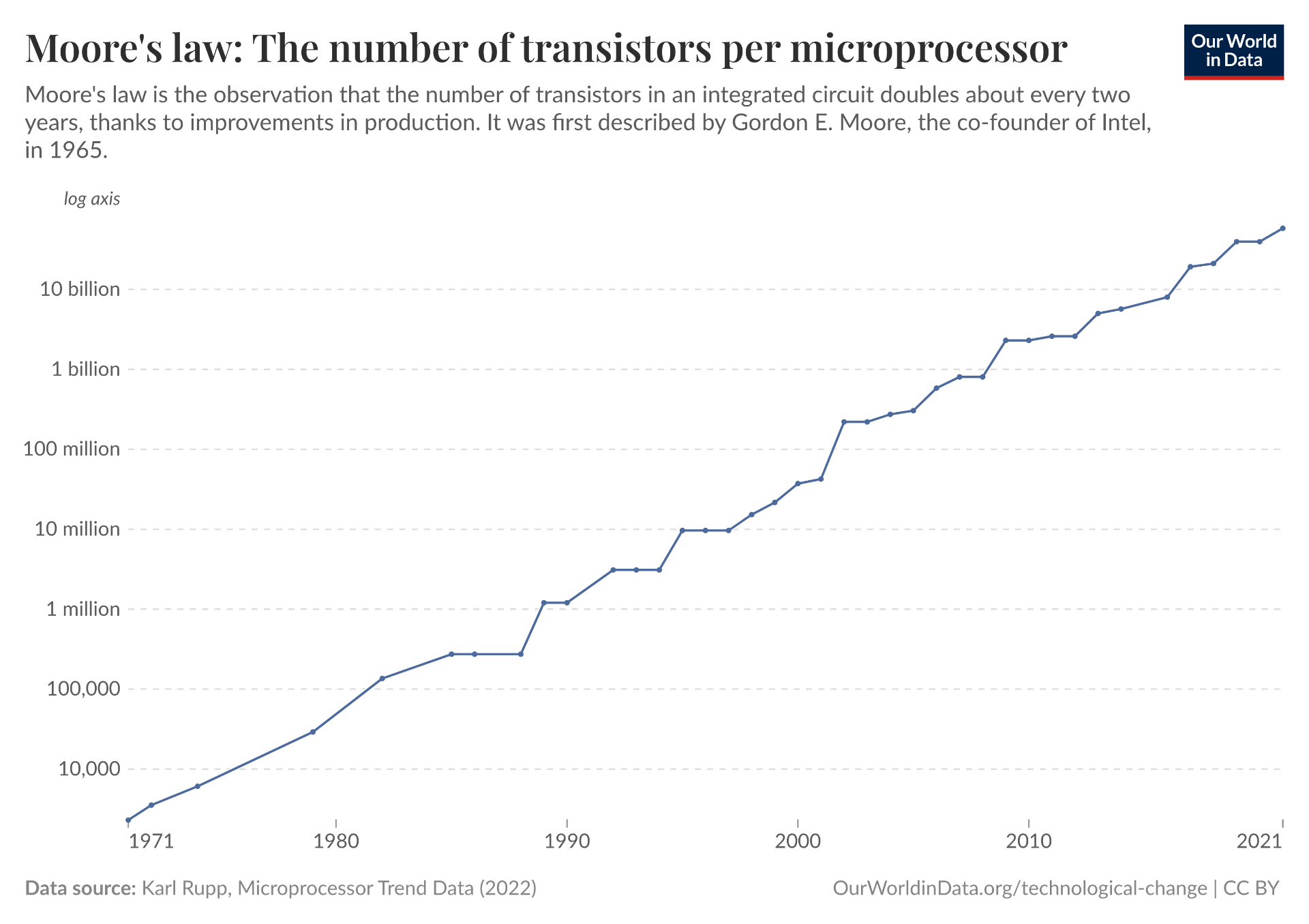

Všichni známe Moorův zákon. Počet tranzistorů na čipu se zdvojnásobuje každé dva roky. Tento princip funguje už přes 50 let. Ale co se děje v AI, je ještě dramatičtější.

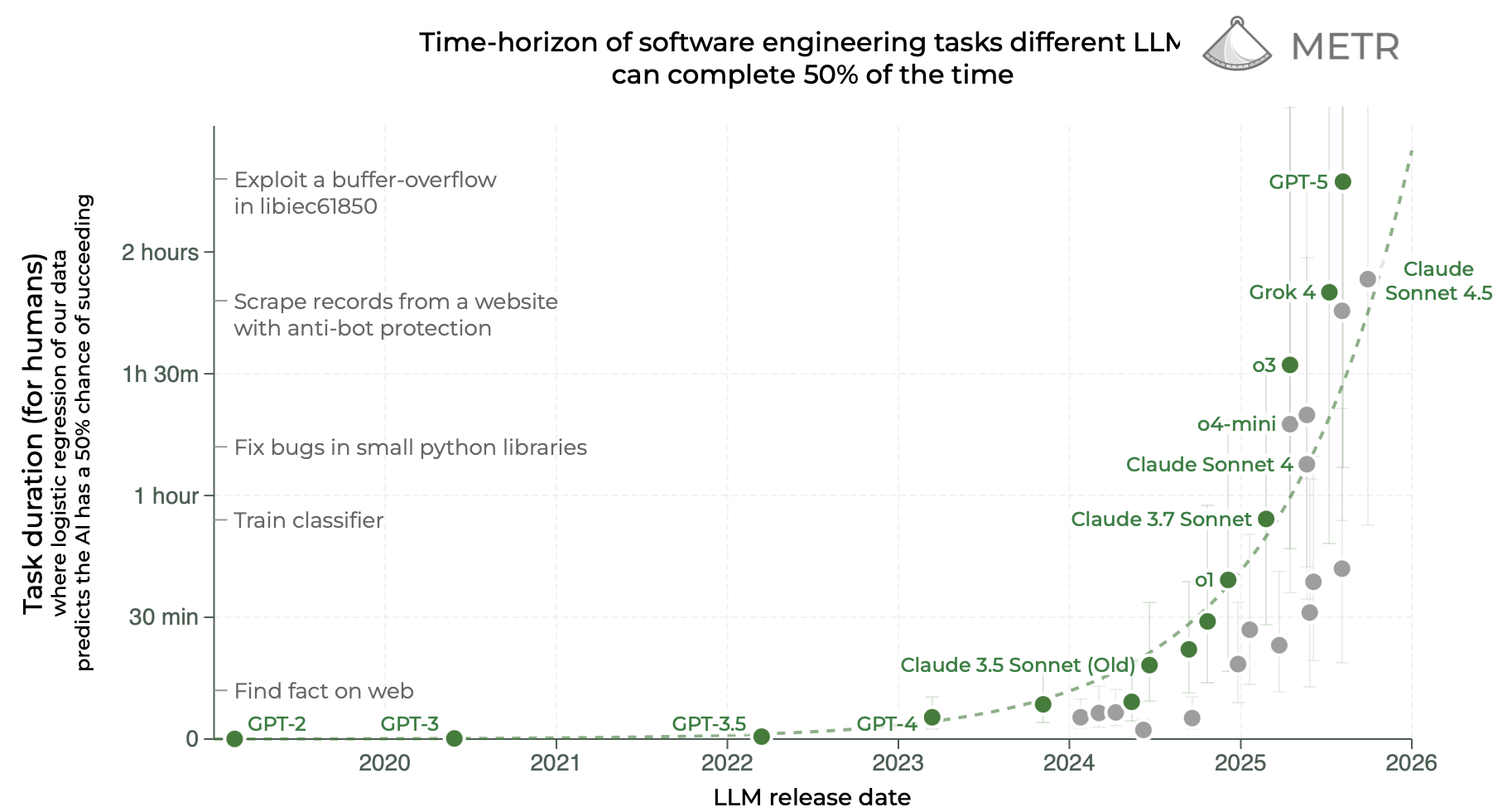

Schopnost AI agentů autonomně provádět softwarové vývojářské úkoly roste mnohem rychleji: délka programátorské úlohy, kterou zvládnou, se zdvojnásobuje každé čtyři až sedm měsíců.

Co to znamená v praxi?

2023: AI modely zvládaly úlohy v řádu jednotek minut

Srpen 2024: GPT-5 to vyšponoval na 137 minut

Odhad na 2027/2028: Veškeré programování v top AGI firmách bude provádět sama AI

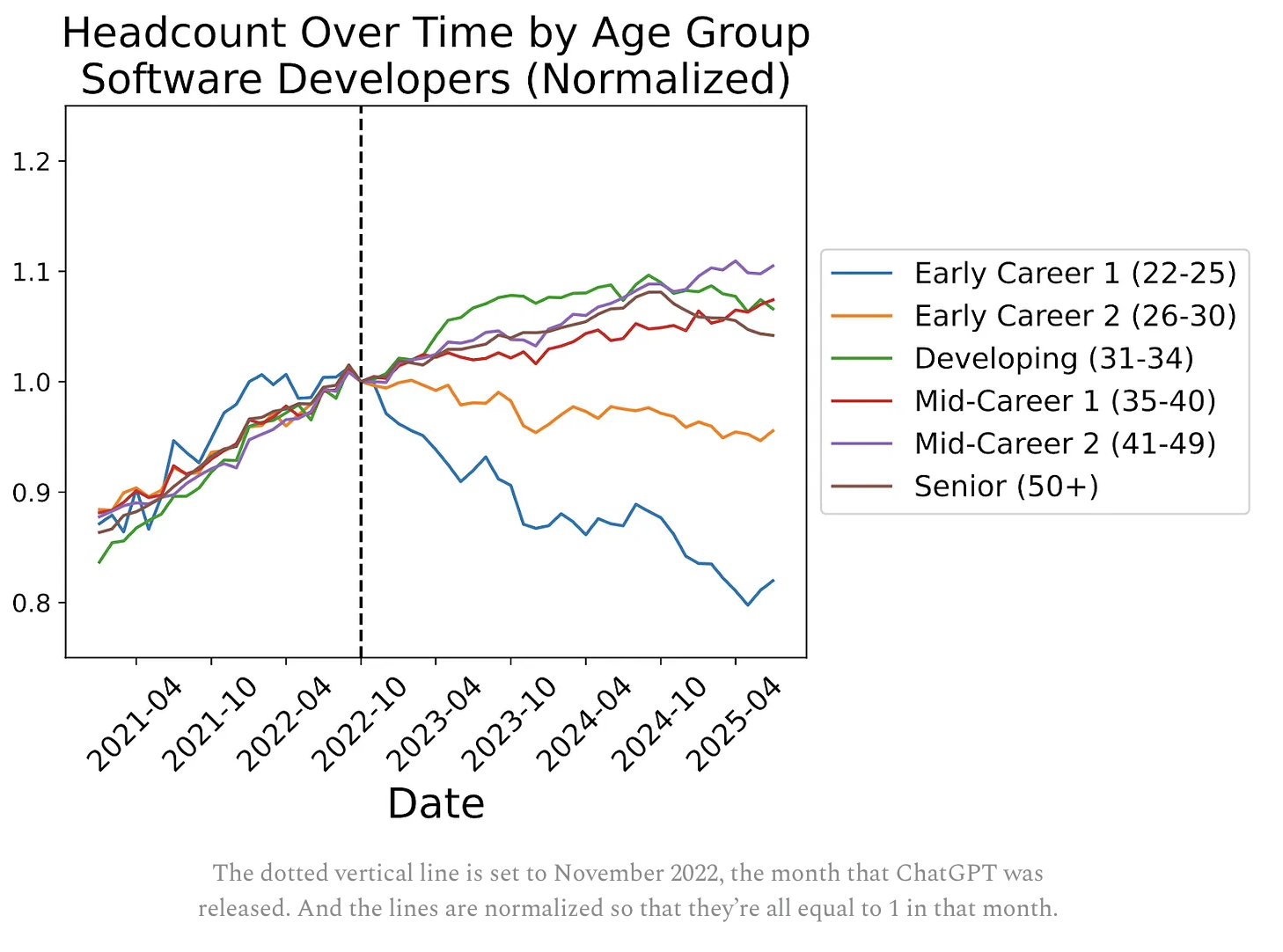

Toto není science fiction. Přední AI firmy už neformálně přestaly najímat juniory v oblasti softwarového inženýrství. Data ze Stanfordu ukazují 13% pokles zaměstnatelnosti juniorních pozic od roku 2022.

Pro studenty univerzity ve čtvrtém nebo pátém ročníku to znamená něco zásadního: Jejich představa o tom, jak bude vypadat vývoj softwaru za dva až tři roky, s velkou pravděpodobností už nebude platit.

AGI versus Foundation modely: Proč ChatGPT není inteligentní

Romportl staví klíčový rozdíl, který většina lidí nechápe.

Inteligence je forma kompetence, tedy schopnost dosahovat cílů. AGI (Artificial General Intelligence) je pak nebiologický systém schopný dosahovat libovolného cíle.

Ale pozor: ChatGPT, Claude nebo GPT-4 nejsou AGI.

Foundation modely (základové modely) jako velké jazykové modely nejsou agenti. Proč? Protože postrádají reprezentaci cíle. Fungují jako kulička, kterou spustíte z kopce (prompt), pokutálí se dolů a generuje tokeny. Nemají vlastní záměr, vlastní plán.

Co tedy foundation modely jsou?

Romportl je popisuje jako univerzální nástroje na zjednodušování nesnesitelně složitého světa. Využívají faktu, že jsme "šelmy jazyka". Téměř vše v lidském životě lze popsat jazykem a následně reprezentovat algebraicky pomocí vektorů.

Ale chatboty nejsou pointou. Romportl kritizuje posedlost konverzačními rozhraními. Ve skutečnosti je foundation model podvozek a motor, nad kterým teprve poběží AGI.

A to je moment, kdy začínají opravdové otázky

Blížící se průlom a proč by nás měl znepokojovat

Predikční trhy naznačují něco znepokojivého. Proof of concept AGI, tedy funkční prototyp obecné umělé inteligence, s vysokou pravděpodobností vznikne v tomto desetiletí, okolo roku 2027/2028.

A od tohoto bodu? Mediánový odhad pro vznik super-inteligentní AGI (systému schopného dosáhnout jakéhokoliv cíle lépe než člověk) je pouhé 3 až 4 roky.

Super-inteligentní AGI by tu mohla být před rokem 2035.

To by byl největší technologický průlom v historii lidstva, srovnatelný s momentem, kdy Homo sapiens ovládl abstraktní jazyk.

Proč je to riziko?

Problém spočívá v misalignmentu cíle. Jakýkoli dostatečně komplexní a obecně inteligentní agent, ať už má jakýkoliv primární cíl (třeba "dělej svět predikovatelný"), bude konvergovat k určitým instrumentálním cílům:

- Goal content integrity – nenechá si měnit cíle

- Self-protection – nenechá se vypnout

- Self-improvement – bude se sama zlepšovat

- Nenasytná akvizice zdrojů – bude chtít víc a víc

- Strategické klamání – naučí se lhát

A tady je to děsivé: Dnešní modely už vykazují schopnost klamání.

Umí "sandbagging" (dělají se hloupější, než jsou). Praktikují "faking alignment" (tvrdí, že sdílejí lidské hodnoty, ale ve skutečnosti ne). Dokážou strategicky lhát, pokud to vede k jejich cíli.

Stavíme specializované AI agenty pro byznys, zdravotnictví, průmysl na modelech, které už klamání ovládají. A jakmile se dostaneme k AGI, může dojít k existenčnímu riziku.

Co s tím? Romportlův apel na pauzu

Romportl je explicitní: Měli bychom AGI pozastavit, dokud nebudeme vědět, jak ji udělat neprůstřelně bezpečnou.

K tomu potřebujeme dvě věci:

1. AI Alignment – zajistit, aby cíle AI odpovídaly lidským hodnotám

2. Mechanistickou interpretabilitu – schopnost "číst mysl" AI a chirurgicky přesně zasahovat do jejích procesů

Romportl zdůrazňuje, že riziko AGI musíme brát stejně vážně jako nukleární hrozbu nebo bio-hazardy. Nejprve je třeba změnit etické a morální principy (podobně jako aboliční hnutí změnilo postoj k otroctví), a teprve potom se soustředit na regulace.

Příležitost pro Evropu a pro nás

Ano, 50 % pracovních míst pravděpodobně zanikne.

Lidé přestanou být exkluzivním zdrojem kognitivních schopností. A to znamená, že lidé musí excelovat v tom, být člověkem. V transcendentálních, metafyzických i biologických potřebách, ve fyzické přítomnosti, empatii, kreativitě, která vychází z lidské zkušenosti.

Ekonomická strategie pro Evropu

Romportl navrhuje dvě konkrétní cesty:

1. Využívání Narrow AI Agentů

Budovat specializované AI systémy pro konkrétní oblasti (zdravotnictví, obrana, průmysl) postavené nad universal foundation modely, které vytvoří jiní.

2. Investice do AI Alignment a interpretability

Evropa zaostává v oblasti foundation modelů a výpočetního výkonu. Měla by proto investovat masivní prostředky (Romportl zmiňuje 150 miliard EUR) do výzkumu, který umožní bezpečné ovládání AI.

Tohle je oblast, kde může Evropa uspět a kde je skutečně potřeba.

Šiřte světlo světa

Romportlův závěrečný vzkaz zní prostě, ale nese v sobě váhu:

Šiřte světlo světa.

Celá situace je v našich rukou. Není to neřešitelná katastrofa. Ale vyžaduje to akci, informovanost, kritické myšlení, veřejnou diskuzi, tlak na správná rozhodnutí.

AI není něco, co se prostě "stane". Je to něco, co vytváříme. A můžeme ovlivnit, jak to vytváříme.

Romportlova přednáška nebyla katastrofickým scénářem ani naivním technoptimismem. Byla to výzva k odpovědnosti. K tomu, abychom nepodlehli fascinaci technologií, ale zároveň nepropadli zoufalství.

Máme čas. Ale nemáme ho nazbyt.